안녕하세요! MiTornAve입니다.

첫 번째 시리즈 <뉴럴 네트워크: 기초부터 하이브리드까지>에 오신 여러분들 진심으로 환영합니다!

2016년, 알파고와 이세돌 사범의 대국 이후 어느덧 10년이 흘렀습니다. 이제는 정말 'AI 시대'라는 말이 체감되는 세상입니다. 단순한 도구를 넘어 일상 곳곳에 침투한 이 AI들이 도대체 어떻게 생각하고 작동하는지 궁금하지 않으셨나요?

이번 시리즈는 저의 전공이자 연구 과제였던 Neural Network(신경망)를 중심으로, 기초부터 심화까지 제대로 한 번 정리해 보고자 기획했습니다.

현재 AI의 발전 속도는 정말 어마무시하죠.

"도.대.체 이 친구들이 어떤 놈들인지, 그리고 어디에 사용되어야 하는 것인지?"에 대해

명확한 답은 아니겠지만, 저 나름의 연구와 경험을 담아 정리를 해보았습니다.

가장 기초적인 이론부터 실제 사례를 연습해 볼 수 있는 Colab 코드까지 준비되어 있으니, 저와 함께 차근차근 공부하며 AI의 심장부로 들어가 보시죠!

그 대망의 첫 번째 시간, AI의 첫 번째 세포 '퍼셉트론' 이야기부터 시작합니다.

1. 뉴런, 생각의 출발: 우리 머릿속의 반도체

인간은 어떻게 '생각'을 하고, 사물을 '인식'할까요?

이 질문에 답하기 위해 19세기 말부터 수많은 과학자가 인간의 뇌를 파헤치기 (실제로 파헤쳤다) 시작했습니다. 그 결과, 우리 뇌 속에는 '뉴런(Neuron)'이라고 불리는 약 860억 개의 아주 특별한 신경세포가 거대한 네트워크를 이루고 있다는 사실을 발견하게 됩니다.

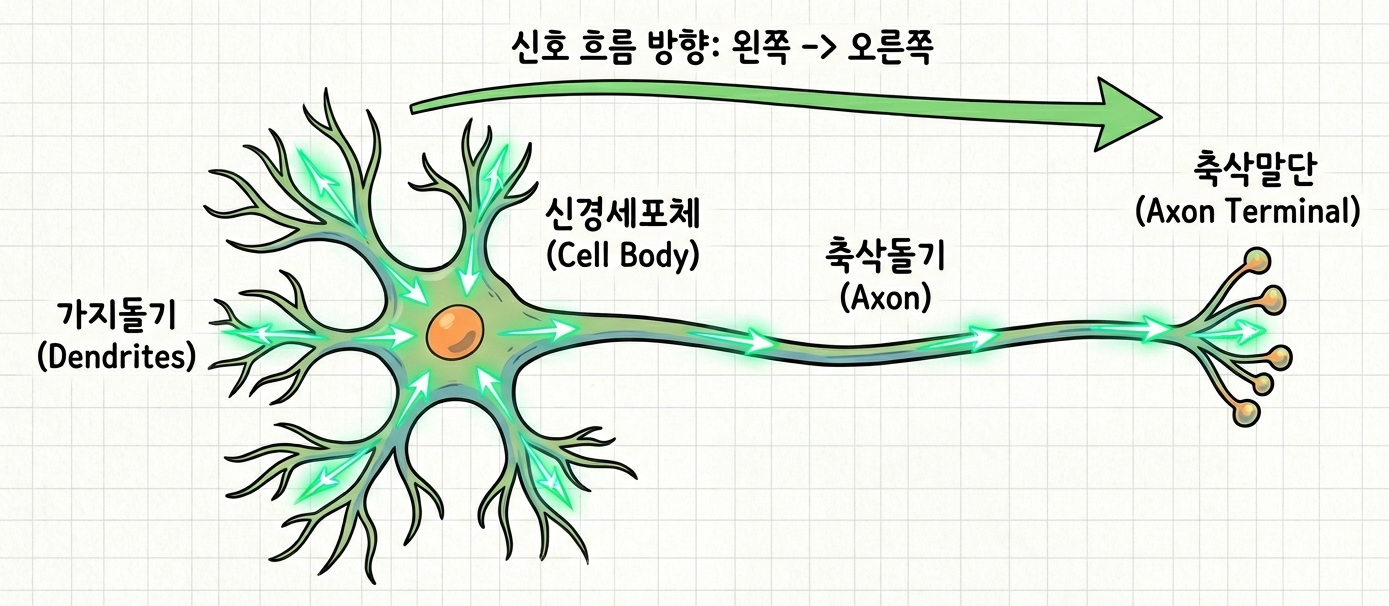

뉴런의 동작 원리는 의외로 단순하면서도 명쾌합니다. 이 단순한 동작 구조가 겹겹이 쌓여, 다양한 전기신호들을 만들어내고, 그것이 '생각'으로 전환됩니다. 그림과 함께 한 번 살펴보겠습니다.

가지돌기(Dendrite): 외부의 다른 뉴런들로부터 전달되는 수많은 '전기 신호'를 받아들이는 안테나 역할을 합니다.

신경세포체(Cell Body): 안테나로 들어온 수많은 신호를 한데 모읍니다. 여기서 중요한 건, 모든 신호를 다 통과시키는 게 아니라는 점이에요. 들어온 신호들의 총합이 특정 '문턱(Threshold)'을 넘어야만 다음 단계로 전달합니다.

축삭돌기(Axon): 문턱을 넘은 강력한 신호를 다음 뉴런에게 쏴주는 고속도로입니다.

시냅스(Synapse): 뉴런과 뉴런 사이의 좁은 틈입니다. 여기서 신호의 강도가 조절됩니다. 자주 쓰는 길은 넓어지고, 안 쓰는 길은 좁아지죠. 이것이 바로 우리가 무언가를 배우는 '학습'의 실체입니다.

여기서 가장 중요한 부분은 바로 신경세포체 입니다.

모든 신호를 통과하는 것이 아닌,

어떠한 기준을 넘어서는 조건에 의해서만 다음 뉴런으로 신호를 보내게 됩니다.

그런데 말입니다. 갑자기 왜 뇌세포 이야기냐구요?

2. 퍼셉트론의 등장: 심리학자가 던진 도전장, "기계도 배울 수 있을까?"

"인간의 사고 과정을 수학 공식으로 옮길 수는 없을까?"

이 단순하지만 발칙한 질문에서 모든 것이 시작되었습니다. 때는 1957년, 코넬 항공 연구소의 심리학자 프랭크 로젠블랏(Frank Rosenblatt)은 이 뉴런의 구조를 그대로 본뜬 수학 모델을 세상에 내놓습니다. 이름하여 '퍼셉트론(Perceptron)'입니다.

재밌는 점은 이 모델을 만든 주인공이 공학자가 아닌 (놀랍게도) '심리학자'였다는 사실입니다. 당시 주류 학계는 기계에 모든 규칙을 일일이 입력해 주는 방식(기호주의)에 매달려 있었지만, 로젠블랏은 인간의 뇌처럼 기계가 스스로 연결 강도를 조절하며 배워야 한다고 믿었습니다.

하나의 퍼셉트론. 놀랍게도 뉴런의 구조를 빼다 박았다.

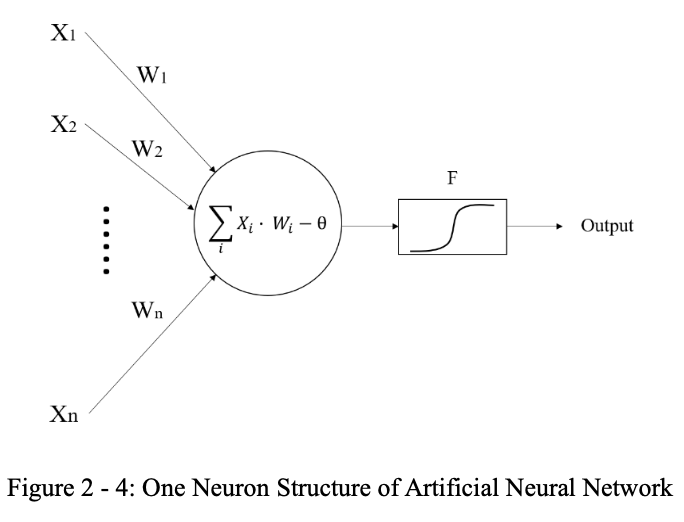

로젠블랏은 뉴런의 각 부위를 다음과 같이 수학으로 치환했습니다.

입력값(x): 가지돌기로 들어오는 전기 신호.

가중치(w): 시냅스에서 조절되는 신호의 강도. (어떤 정보가 더 중요한가!)

가중합: 들어온 신호에 중요도(가중치)를 곱해 모두 더한 값.

활성화 함수(임계치 f): 합산된 값이 기준을 넘으면 1(전달), 못 넘으면 0(차단).

이것이 바로 로젠블랏이 설계한 '인공 뉴런'입니다.

"스스로 학습하는 기계"의 탄생

당시 퍼셉트론의 등장은 지금의 챗GPT 열풍 그 이상이었습니다. (정말이다) 1958년 뉴욕 타임즈는 이 발명을 두고 "해군이 스스로 걷고, 말하고, 보고, 쓰고, 심지어 자신의 존재를 의식하게 될 컴퓨터의 시초를 발표했다"며 대서특필했습니다.

비록 지금 보면 선 하나 긋는 단순한 구조였지만, 퍼셉트론은 인류 역사상 최초로 '학습(Learning)'이라는 추상적인 개념을 '수학적 메커니즘'으로 완벽하게 정리해냈습니다. 데이터가 틀리면 가중치(w)를 스스로 수정(Self-Correction)하며 정답에 가까워지는 모습은, 그야말로 기계에 지능의 씨앗을 심은 것과 같았죠.

3. Decision Boundary: 선 하나로 세상의 기준을 세우다

퍼셉트론이 어떻게 데이터를 분류하는지, 그 본질을 가장 수학적이면서도 직관적으로 이해하는 방법은 바로 '기하학'입니다. 어렵게 생각할 것 없습니다. 우리, 눈앞에 펼쳐진 평면을 상상해 볼까요?

종이 위에 모세의 기적을 그려보자.

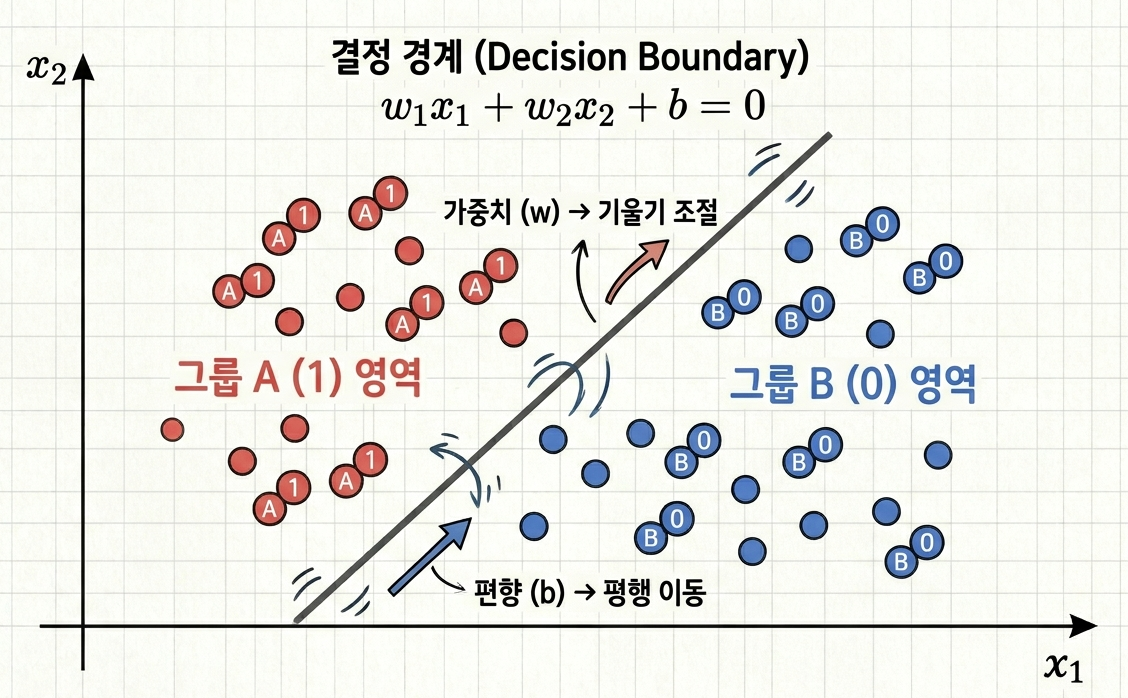

2차원 종이 위에 빨간색 점(A 그룹)과 파란색 점(B 그룹)이 여기저기 흩어져 있다고 상상해 봅시다. 퍼셉트론에게 주어진 단 하나의 임무는 이 두 그룹을 완벽하게 갈라놓는 단 하나의 직선을 긋는 것입니다.

이 직선이 바로 인공지능이 세상을 판단하는 기준, 결정 경계(Decision Boundary)입니다.

우리가 흔히 보는 퍼셉트론의 수식, 기억하시나요?

y = f(w_1x_1 + w_2x_2 + b)

여기서 활성화 함수 f를 걷어내고, 내부에 있는 알맹이 식만 떼어내어 =0으로 만들면, 그것이 바로 우리가 중학교 때 배웠던 그 '직선의 방정식'이 됩니다.

w_1x_1 + w_2x_2 + b = 0

거짓말 치지 마세요. 중학생 때 배웠다구요?

안타깝게도 배우 셨던 것은 사실입니다. 단지, 수식이 다소 다를 수 있습니다. 위의 수식에서 x_1,x_2를 각각 x와y로 치환하면, y = (w_1/w_2)x - b라는 익숙한 수식이 나오게 됩니다. 봐요. 직선의 방정식 맞죠?? 아무튼,

"이 선을 넘으면 파란색이다"

퍼셉트론은 학습 데이터를 보면서 이 직선을 이리저리 움직이고, 회전시킵니다. 가중치($w$)는 직선의 기울기를 바꾸고, 편향($b$)은 직선을 평행 이동시키죠.

그렇게 최적의 위치를 찾으면, 퍼셉트론은 아주 냉정하게 선언합니다.

"이 직선의 위쪽 영역에 있는 데이터는 모두 빨간색(1)이다."

"이 직선의 아래쪽 영역에 있는 데이터는 모두 파란색(0)이다."

이것이 바로 현재의 거대한 AI 시스템들이 수행하는 가장 기초적이고 핵심적인 동작, '분류(Classification)'의 원리입니다. 퍼셉트론은 복잡한 세상을 단 하나의 '직선'이라는 기준으로 편 가르기 하는, 아주 단순하지만 강력한 '이분법적 사고'의 소유자였던 셈입니다.

4. 희망과 절망의 교차로: 논리 게이트 정복과 치명적인 'XOR'의 덫

퍼셉트론의 작동 원리를 이해했다면, 이제 이 친구가 정말 '지능'을 가질 수 있는지 시험해 볼 차례입니다. 우리는 기계에게 가장 기초적인 사고방식인 '논리 연산(Logic Gate)'을 가르쳐 보려 합니다.

이 과정은 퍼셉트론에게 거대한 희망을 안겨주었지만, 동시에 감당할 수 없는 절망을 선사하며 AI 역사를 뒤흔든 사건이 되었습니다.

희망의 서막: AND/OR 게이트를 너무나 쉽게 배우다

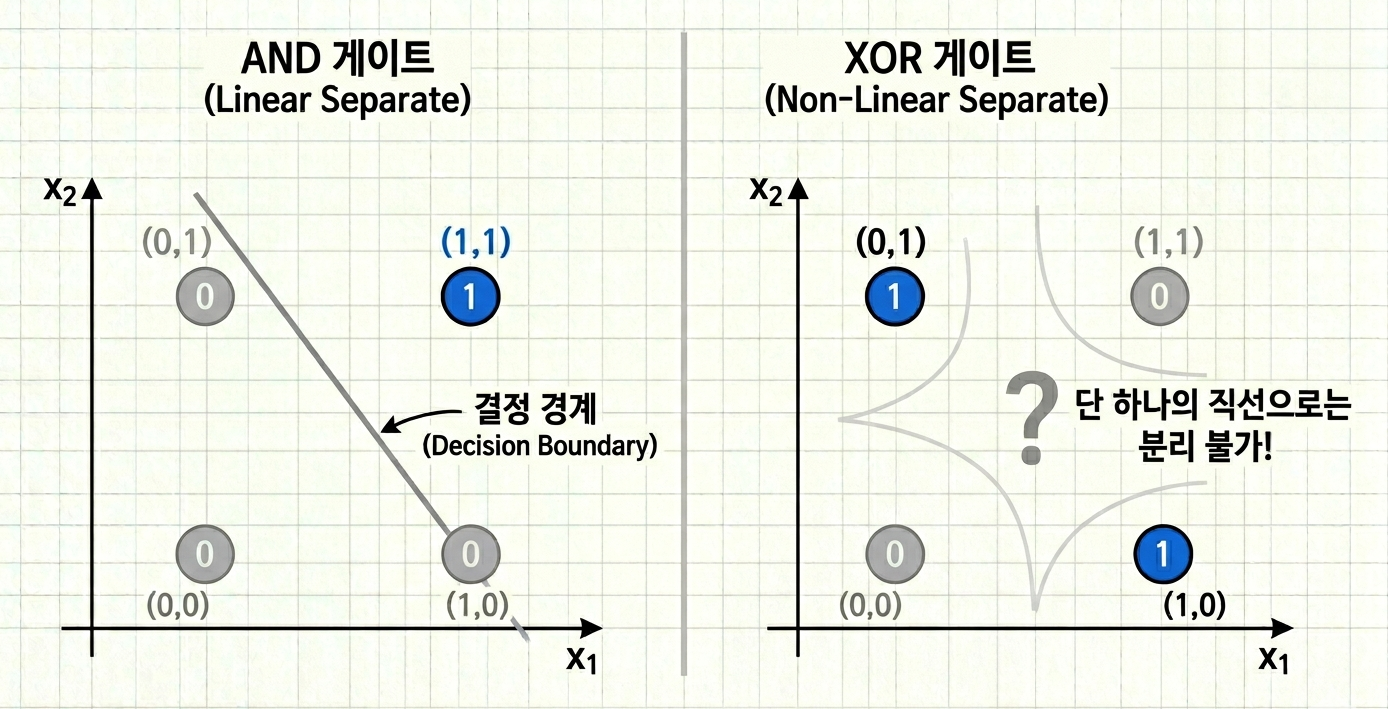

먼저, 퍼셉트론에게 AND 연산을 가르쳐 봅시다. AND는 두 입력이 모두 1(참)일 때만 결과가 1이 되는, 아주 깐깐한 논리입니다.

[0, 0] = 0

[1, 0] = 0

[0, 1] = 0

[1, 1] = 1 (둘 다 1일 때만!)

OR 연산도 마찬가지였습니다. (0,0)만 제외하고 나머지를 1로 분류하는 직선을 아주 쉽게 그어냈죠. 이 작은 성공에 당시 학계는 광분했습니다. "이 단순한 세포를 수천, 수만 개 연결하면 인간 수준의 지능도 만들 수 있겠는데?"라는 거대한 희망이 싹튼 것입니다.

갑작스러운 절망: "XOR"이라는 풀 수 없는 수수께끼

하지만 그 행복했던 희망은 1969년, AI 학계의 대부였던 마빈 민스키(Marvin Minsky) 교수가 던진 XOR 문제라는 거대한 장벽에 부딪혀 산산조각이 납니다.

XOR(배타적 논리합)은 두 입력이 서로 다를 때만 1을 출력하는 논리입니다.

(0, 0) = 0

(0, 1) = 1

(1, 0) = 1

(1, 1) = 0

민스키 교수는 아주 냉철하게 지적했습니다.

"종이 위에 이 네 개의 점을 찍고, 단 하나의 직선으로 0과 1을 갈라봐라."

...여러분도 한 번 시도해 보세요.

점 (0,1)과 (1,0)을 잇는 영역을 1로 만들려면, 반드시 곡선이거나 두 개 이상의 직선이 필요합니다.

첫 번째 'AI 겨울'의 도래: "선 하나로는 부족해"

우리가 앞선 섹션에서 강조했듯, 퍼셉트론은 근본적으로 선형 분리(Linear Separation), 즉 '직선 하나'밖에 긋지 못하는 단순한 모델이었습니다. 이 너무나 단순한 논리 문제조차 해결하지 못하는 세포 하나에 "인간의 지능을 구현할 수 있다"고 믿었던 것은, 당시로서는 너무나 순진한 생각이었죠.

이 통렬한 비판 이후, AI 연구에 대한 정부 지원은 끊겼고 대중의 관심도 싸늘하게 식었습니다. 기대가 많았던 만큼 실망도 컸으며, 이는 십 수년간 퍼셉트론을 이용한 AI의 구조 발전을 멈추게 만들었습니다.

5. 정리하며

오늘은 AI의 아주 작은 조상님, 퍼셉트론에 대해 알아봤습니다.

직선 하나로 세상을 다 가질 줄 알았던 이 녀석이 고작 XOR이라는 작은 문턱에 걸려 넘어지는 걸 보니 어떤 생각이 드시나요? 당시 과학자들은 정말 뒤통수를 세게 맞은 기분이었을 겁니다. "겨우 이거 하려고 예산을 그렇게 썼어?"라는 비난과 함께 AI 연구는 기나긴 암흑기, 즉 '겨울'로 접어들게 되죠.

하지만 재미있는 건, 여기서 포기하지 않은 사람들이 있었다는 겁니다. "직선 하나로 안 돼? 그럼 선을 두 개 그으면 되잖아? 아니면 선을 겹겹이 쌓아보든가!"

이 단순하고도 무식한(?) 아이디어가 지금 우리가 쓰는 챗GPT, 자율주행차를 만든 거대한 신경망의 시초가 됩니다. 역시 안 되면 되게 하라는 말은 공학계의 진리인가 봅니다.

우리는 다음 시간, 이 절망적인 XOR 문제를 아주 우아하게 해결하며 등장한 다층 퍼셉트론(MLP), 그리고 "야, 너 틀렸으니까 다시 계산해!"라고 뒤에서 채찍질하는 역전파(Backpropagation) 알고리즘을 파헤쳐 볼 겁니다.

핵심 키워드 체크리스트

MCP 뉴런: 생물학적 뇌세포를 수학적으로 모방한 최초의 모델.

가중치(Weight) & 편향(Bias): 입력값의 중요도를 결정하고 판단의 기준선을 조절하는 핵심 변수.

임계치(Threshold): 신호를 보낼 것인가, 말 것인가를 결정하는 '문턱'.

선형 분리(Linear Separation): 퍼셉트론이 가진 강력한 무기이자 치명적인 한계.

XOR 문제: 인공지능의 첫 번째 겨울을 불러온 '풀 수 없는 수수께끼'.